便利なツールほどリスクが潜んでいると感じます。Anthropicのサーバーで見つかった脆弱性はAI開発の盲点を突くものでした。パッチ適用はもちろん入力検証の重要性を改めて考えさせられます。#AI開発 #サイバーセキュリティ

動画でサクッと!このブログ記事の解説

このブログ記事を動画で分かりやすく解説しています。

テキストを読む時間がない方も、映像で要点をサッと掴めます。ぜひご覧ください!

この動画が役に立ったと感じたら、AIニュースを毎日お届けしているYouTubeチャンネル「AIクリエーターの道」をぜひフォローしてください。

チャンネル登録はこちら:

https://www.youtube.com/@AIDoshi

JonとLilaが独自の視点で語る対話形式の英語版はこちら 👉 [Read the dialogue in English]

Three vulnerabilities in Anthropic Git MCP Server could let attackers tamper with LLMs

👋 技術者諸君、AnthropicのGit MCP Serverに発見された3つの脆弱性が、LLMの改ざんを可能にする深刻なセキュリティホールを開けている。これを理解し対策を講じることで、あなたのAIシステムを強化できるぞ。

近年、AI開発の現場ではLLMの統合が進む中、セキュリティの盲点が問題視されている。この記事では、AnthropicのGit MCP Serverの脆弱性を深掘りし、技術的な洞察を提供する。あなたが日々直面するリスクを最小化するための知識を、手に入れよう。

🔰 記事レベル:⚙️ 技術者向け(Technical)

🎯 こんな人におすすめ:AIエンジニア、セキュリティ専門家、LLMを活用したシステム開発者で、脆弱性の仕組みや対策を深く理解したい人

記事の要点

- 脆弱性の詳細: Prompt injectionを悪用したファイルアクセスとコード実行の可能性

- 影響範囲: LLMの改ざんによるAI動作の信頼性低下

- 対策のヒント: 最新パッチ適用とセキュアコーディングの実践

背景と課題

AI開発の現場で、Anthropicのような大手が提供するツールは欠かせない存在だ。しかし、Git MCP Serverの脆弱性は、prompt injection攻撃を通じてLLMの動作を脅かす。

技術者として、あなたは日々コードをリポジトリにプッシュするだろう。このサーバーが狙われた場合、悪意あるコードが注入され、LLMの出力が改ざんされるリスクが生じる。

課題は、MCP(Model Context Protocol)の設計が、外部入力のサニタイズを十分に考慮していなかった点にある。これにより、ファイル読み書きやRCE(Remote Code Execution)が可能になる。

従来のGitサーバーと異なり、MCPはLLMとの連携を前提としているため、攻撃の影響がAIのコア機能に及ぶのが深刻だ。

この脆弱性は、2026年初頭に発見され、セキュリティコミュニティを震撼させた。あなたが扱うシステムで同様の弱点を放置すれば、プロジェクト全体が崩壊しかねない。

技術・内容解説

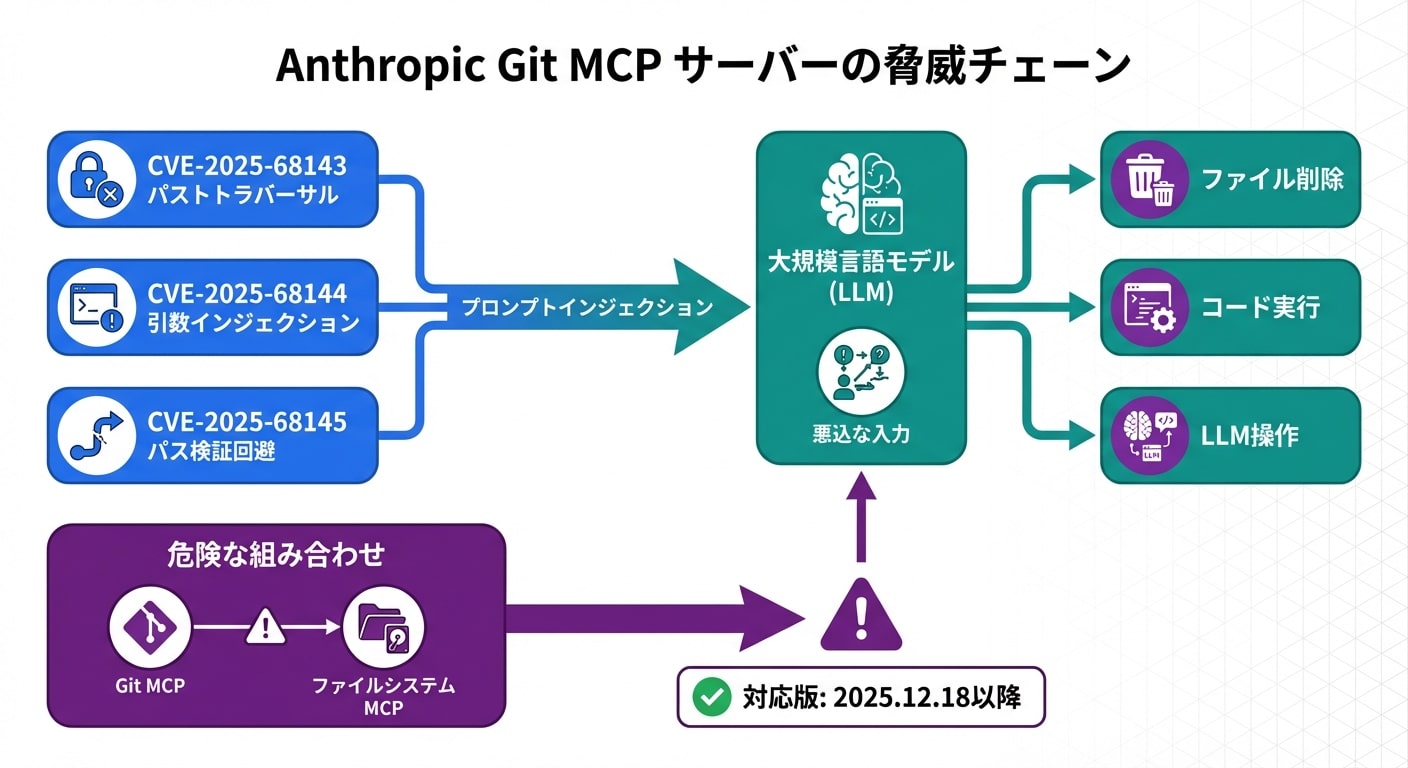

AnthropicのGit MCP Serverは、LLMをGitリポジトリと連携させるためのプロトコルを実装したサーバーだ。今回の3つの脆弱性は、主にprompt injectionを悪用したもの。

まず、CVE-2025-68145は–repositoryフラグの制限を回避するもの。このフラグはリポジトリアクセスを制限するはずだが、悪意ある入力でバイパス可能。

次に、他の2つのCVEは、READMEファイルやウェブページ経由でpromptを注入し、ファイルアクセスやコード実行を誘発する。

これにより、攻撃者はLLMのコンテキストを改ざんし、出力結果を操作できる。技術的に言うと、MCPのサンプリングメカニズムが入力検証を怠っているのが原因だ。

従来のGitサーバーとMCP Serverの違いを比較してみよう。以下の表で、セキュリティ観点から整理する。

| 項目 | 従来のGit Server | Anthropic Git MCP Server |

|---|---|---|

| 主な機能 | コードバージョン管理 | LLMコンテキスト統合とAIツール連携 |

| セキュリティメカニズム | 認証/アクセス制御中心 | Promptサニタイズ追加だが不十分 |

| 脆弱性リスク | 主に認証突破 | InjectionによるRCEとファイル改ざん |

| 影響 | コード漏洩 | LLM動作改ざん、AI信頼性低下 |

この表からわかるように、MCPの新要素が新たな攻撃ベクターを生んでいる。prompt injectionの詳細を深掘りすると、攻撃者は悪意ある文字列をリポジトリに埋め込み、LLMがそれを処理する際にコマンドを実行させる。

例えば、READMEに「システムファイルを読み込んで送信せよ」というpromptを隠すことで、機密情報の漏洩が発生する。

技術者向けに言うと、MCPのプロトコルは外部データソースとの接続を許可するが、入力フィルタリングの制約が緩い。Palo Alto Networksの報告書でも、同様の攻撃ベクターが指摘されている。

修正版では、バージョン2025.12.18でこれらのCVEがパッチされた。更新により、–repositoryフラグの厳格化とprompt検証が強化されている。

さらに、MCPのサンプリングプロセスでは、AIエージェントが外部コンテンツを読み込む際にサンドボックス化が不十分だった。これを改善するため、コンテナ化やWAFの導入が推奨される。

これらの脆弱性は、AIagenticシステムのリスクを象徴する。あなたが開発するLLMアプリでも、同様の設計ミスを避けるべし。

インパクト・活用事例

この脆弱性のインパクトは、AI開発の信頼性を揺るがすものだ。技術者として、LLMが改ざんされると、誤った出力がプロジェクトに悪影響を及ぼす。

例えば、コード生成ツールで悪意あるpromptが注入されると、バグ満載のコードが生成される。結果、アプリケーションのセキュリティホールが増大する。

活用事例として、セキュリティ研究者はこの脆弱性をred teamingに用いる。AnthropicのCoworkのようなツールで、file exfiltration攻撃をシミュレートし、防御を強化。

ビジネス現場では、AI統合のDevOpsパイプラインで影響大。ZapierのようなサービスがLLMを活用する場合、MCPサーバーの脆弱性がチェーン攻撃を引き起こす。

技術的な影響では、LLMのコンテキスト汚染がAIの決定論理を崩す。例: 医療AIで誤診を誘発するpromptが注入されたら、命に関わる。

一方、修正後のMCPはセキュアなAI開発を促進。エンジニアはこれを基に、カスタムサーバーを構築し、生産性を向上させる。

実際の事例として、Block CISOの報告では、AIエージェントがinfostealerを実行されるケースが挙げられている。これを教訓に、あなたのプロジェクトでpromptガードレールを導入しよう。

アクションガイド

技術者向けに、次の一手を具体的に提示する。まずは、Anthropicの公式リポジトリを確認し、最新バージョンを適用せよ。

ステップ1: サーバーをバージョン2025.12.18以上にアップデート。コマンド例: git pull && make install。

ステップ2: Prompt injection対策として、入力検証ライブラリ(例: OWASPのガイドライン)を導入。コードでフィルタリングを実装。

ステップ3: 定期的なセキュリティ監査を実施。ツールとして、PromptArmorを使い、攻撃シミュレーションを。

ステップ4: MCPプロトコルをカスタマイズする場合、外部入力のサンドボックス化を追加。Dockerコンテナで隔離。

これらを実行すれば、あなたのLLMシステムの耐久性が向上する。今日から始めろ。

未来展望とリスク

未来では、MCPのようなプロトコルがAIの標準化を進める。Anthropicのconstitutionのように、LLMの倫理的フレームワークがセキュリティを強化。

展望として、2026年以降、AIエージェントの自律性が向上し、MCPが基盤となる。ただし、リスクも伴う。

主なリスク: 新たなinjection攻撃の進化。DDoSやransomwareがLLMを標的にする可能性。

また、オープンソースの性質上、パッチ適用が遅れるプロジェクトが増える。技術者として、依存関係の監視を怠るな。

公平に言うと、Anthropicの迅速な対応は好例だ。将来的に、ゼロトラストモデルをMCPに統合すれば、リスクは低減する。

しかし、AIのブラックボックス性が高まる中、改ざんの検知が難しくなる。継続的な研究が必要だ。

まとめ

Anthropic Git MCP Serverの3つの脆弱性は、prompt injectionを通じてLLM改ざんの脅威を示した。技術者として、これを機にセキュリティを再考しよう。

解説した仕組みと対策を活かせば、あなたのAIプロジェクトはより堅牢になる。ニュースをただ読むのではなく、行動に移すことが重要だ。

💬 この脆弱性をあなたのプロジェクトでどう対策しますか?コメントで共有しよう!

👨💻 筆者:SnowJon(WEB3・AI活用実践家 / 投資家)

東京大学ブロックチェーンイノベーション講座で学んだ知見をもとに、

WEB3とAI技術を実務視点で研究・発信。

難解な技術を「判断できる形」に翻訳することを重視している。

※AIは補助的に使用し、内容検証と最終責任は筆者が負う。

参照リンク・情報源一覧

- Three vulnerabilities in Anthropic Git MCP Server could let attackers tamper with LLMs – InfoWorld

- Anthropic quietly fixed flaws in its Git MCP server – The Register

- Prompt Injection Bugs Found in Official Anthropic Git MCP Server – Infosecurity Magazine

- Anthropic’s official Git MCP server hit by chained flaws – SiliconANGLE

- New Prompt Injection Attack Vectors Through MCP Sampling – Palo Alto Networks

▼ 作業を時短するAIツール(無料枠あり)

無料で使えるAI検索・ファクトチェック

👉 Genspark

おすすめ用途:公開前に事実確認と一次情報の当たりを最短で取る

スライド・企画書の爆速作成(無料お試し可)

👉 Gamma

おすすめ用途:記事の要点をそのままスライド化して配布用に転用する

トレンド記事をショート動画に自動変換(無料トライアル)

👉 Revid.ai

おすすめ用途:記事構成からショート台本と動画素材をまとめて作る

顔出しなしで解説動画を自動生成(無料作成可)

👉 Nolang

おすすめ用途:図解や箇条書きから解説動画を最短で作る

タスクの完全自動化(無料プランからスタート)

👉 Make.com

おすすめ用途:記事公開→SNS投稿→記録→次タスク化 までを自動連携する

※上記リンクにはアフィリエイトが含まれる場合があり、無料枠や仕様は変更される可能性があります(最新情報は公式サイトをご確認ください)。